JP5453352B2 - Video display device, video display method and program - Google Patents

Video display device, video display method and program Download PDFInfo

- Publication number

- JP5453352B2 JP5453352B2 JP2011146374A JP2011146374A JP5453352B2 JP 5453352 B2 JP5453352 B2 JP 5453352B2 JP 2011146374 A JP2011146374 A JP 2011146374A JP 2011146374 A JP2011146374 A JP 2011146374A JP 5453352 B2 JP5453352 B2 JP 5453352B2

- Authority

- JP

- Japan

- Prior art keywords

- display

- coordinates

- camera

- mirror

- image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Landscapes

- Image Processing (AREA)

- Length Measuring Devices By Optical Means (AREA)

Description

本発明の実施形態は、映像表示装置、映像表示方法およびプログラムに関する。 Embodiments described herein relate generally to a video display device, a video display method, and a program.

近年、デジタルテレビジョン装置においては、カメラを内蔵して、その内蔵カメラによって視聴者を撮影し、撮影した映像を自装置のディスプレイに表示させるタイプのものが知られている。このようなテレビジョン装置においては、カメラが固定されているため、外付けのカメラとは異なって内蔵カメラの位置や光軸等を微調整することができない。 2. Description of the Related Art In recent years, a type of digital television apparatus is known in which a camera is incorporated, a viewer is photographed by the built-in camera, and the photographed video is displayed on the display of the apparatus. In such a television apparatus, since the camera is fixed, the position and optical axis of the built-in camera cannot be finely adjusted unlike an external camera.

従来、カメラで撮影されたカメラ映像をディスプレイに表示する場合には、カメラ映像の表示位置や回転角度、その他の画像の歪み等を画像処理によって補正し、補正後の映像をディスプレイに表示させる技術が知られている。 Conventionally, when displaying a camera image captured by a camera on a display, a technique for correcting the display position and rotation angle of the camera image, other image distortion, etc. by image processing and displaying the corrected image on the display It has been known.

しかしながら、従来技術においては、テレビジョン装置に固定して設けられたカメラで撮影されたカメラ映像を補正するキャリブレーション方法については開発途上であり、簡便に行うことができるキャリブレーション方法が望まれていた。 However, in the prior art, a calibration method for correcting a camera image captured by a camera fixed to a television device is under development, and a calibration method that can be easily performed is desired. It was.

本発明が解決しようとする課題は、テレビジョン装置に固定されたカメラのキャリブレーションを行い易い映像表示装置、映像表示方法およびプログラムを提供することである。 The problem to be solved by the present invention is to provide a video display device, a video display method, and a program that facilitate calibration of a camera fixed to a television device.

実施形態の映像表示装置は、カメラと、ディスプレイと、第1表示手段と、検出手段と、算出手段と、位置検出手段と、補正手段と、を備える。前記第1表示手段は、前記ディスプレイに所定の表示座標を基準として所定の図形を表示させる。前記検出手段は、鏡に映し出された前記図形の鏡像を前記カメラで撮影して得られたカメラ映像上において、前記鏡像を検出した検出座標を取得する。前記算出手段は、前記所定の図形の表示座標と前記鏡像の検出座標との相対的位置関係に基づいて、前記カメラで撮影されたカメラ映像における座標を前記ディスプレイの表示座標に対応させるための補正係数を算出する。前記位置検出手段は、カメラ映像に含まれている人の顔の位置を検出する。前記補正手段は、前記ディスプレイの表示座標に対する前記顔の位置を前記補正係数によって補正する。 Video display apparatus embodiment comprises a camera, and de Isupurei, a first display means, a detection means, a calculation unit, a position detection means, and correcting means. The first display means displays a predetermined graphic on the display with a predetermined display coordinate as a reference. The detection means obtains detection coordinates at which the mirror image is detected on a camera image obtained by photographing a mirror image of the figure projected on a mirror with the camera. Said calculation means, based on the relative positional relationship between the detected coordinates of the mirror image and the display coordinates of the predetermined graphic, the order of the coordinates in the captured camera image by the camera in correspondence with the display coordinates of the display A correction coefficient is calculated. The position detecting means detects a position of a human face included in the camera image. Wherein the correction means corrects the position of the face with respect to the display coordinates of the display by the correction factor.

図1は、実施形態にかかる映像表示装置であるテレビジョン装置1の一例を示す外観斜視図である。図1に示すように、テレビジョン装置1は、前方から見た正面視(前面に対する平面視)で、長方形状の外観を呈している。テレビジョン装置1は、筐体2と、ディスプレイ3を備えている。ディスプレイ3は、例えばLCD(Liquid Crystal Display)等で構成され、後述する映像処理部17(図2参照)から映像信号を受け取り、静止画や動画等の映像を表示する。また、筐体2にはカメラ4が設けられている。このカメラは、例えばテレビジョン装置1の視聴者等を撮影する目的で用いることができる。また、筐体2は、支持部5に支持されている。

FIG. 1 is an external perspective view showing an example of a television device 1 which is a video display device according to an embodiment. As shown in FIG. 1, the television apparatus 1 has a rectangular appearance when viewed from the front (when viewed from the front). The television apparatus 1 includes a

図2は、テレビジョン装置1の信号処理系を示すブロック図である。図2に示すように、テレビジョン装置1は、アンテナ12で受信したデジタルテレビジョン放送信号を、入力端子13を介してチューナ部14に供給することにより、所望のチャンネルの放送信号を選局することが可能になっている。チューナA141およびチューナB142は地上デジタル放送受信用のチューナであり、チューナC143はBS/CSデジタル放送受信用のチューナである。なお、図2においては、チューナを3台有している場合について示すが、チューナの数はこれに限定されるものではない。

FIG. 2 is a block diagram showing a signal processing system of the television apparatus 1. As shown in FIG. 2, the television apparatus 1 selects a broadcast signal of a desired channel by supplying a digital television broadcast signal received by an antenna 12 to a

チューナ部14は受信した放送信号を復調復号部15に出力する。復調復号部15は、入力された放送信号をデジタルの映像信号及び音声信号等に復元し、入力信号処理部16に出力する。

The

テレビジョン装置1には、テレビジョン装置1の外部からデジタルの映像信号又は音声信号を直接入力するための入力端子21が設けられている。入力端子21を介して入力されたデジタルの映像信号及び音声信号は、記録再生処理部29に入力される。

The television apparatus 1 is provided with an

操作部24は、筐体2に設けられ、電源のオン・オフを行うスイッチ、チャンネルを切り替えるスイッチ等を備えている。受信部26は、リモートコントローラ(以下、リモコンと略称する)25から信号を受信して受信した信号を制御部40に出力する。制御部40は、操作部24またはリモコン25におけるユーザの操作に基づいて再生、チャンネル切替、録画予約等の指示を受付ける。

The operation unit 24 is provided in the

ディスクドライブ部27は、例えばDVD(Digital Versatile Disk)等の光ディスク28に対してデジタルデータの記録再生を行う。ディスクドライブ部27は、制御部40の指示に基づいて光ディスク28からデジタルの映像信号、音声信号を読み出し、記録再生処理部29に出力する。また、ディスクドライブ部27は、記録再生処理部29から入力されたデジタルの映像信号、音声信号を光ディスク28に記録する。

The disk drive unit 27 records and reproduces digital data on an

HDD20は、内部に備えるハードディスクに対する記録および再生を行う。HDD20は、制御部40の指示に基づいてハードディスクからデジタルの映像信号、音声信号を読み出し、記録再生処理部29に出力する。また、HDD20は、記録再生処理部29から入力されたデジタルの映像信号、音声信号をハードディスクに記録する。

The HDD 20 performs recording and reproduction with respect to an internal hard disk. The HDD 20 reads digital video signals and audio signals from the hard disk based on instructions from the

記録再生処理部29は、復調復号部15、入力端子21、ディスクドライブ部27、HDD20、図示しないネットワークインタフェースから入力されるデジタルの映像信号、音声信号を暗号化し所定の記録フォーマットに変換する。そして変換後の信号をディスクドライブ部27またはHDD20に出力する。また、記録再生処理部29は、ディスクドライブ部27またはHDD20から読み出されたデジタルの映像信号、音声信号を複合化して、入力信号処理部16に出力する。

The recording / reproducing

入力信号処理部16は、復調復号部15または記録再生処理部29から入力されたデジタルの映像信号及び音声信号に対して所定のデジタル信号処理を施す。入力信号処理部16は、デジタルの映像信号を映像処理部17に出力し、デジタルの音声信号を音声処理部18に出力する。

The input

映像処理部17は、入力信号処理部16または制御部40から入力されたデジタルの映像信号を、ディスプレイ3で表示可能なフォーマットのアナログ映像信号に変換して、ディスプレイ3に入力する。ディスプレイ3は、映像処理部17から出力されたアナログ映像信号によって、番組の視聴画面や、その他の映像等を表示する。

The

音声処理部18は、入力信号処理部16から入力されたデジタルの音声信号を、後段のスピーカ19で再生可能なフォーマットのアナログ音声信号に変換して、スピーカ19に入力する。スピーカ19は、音声処理部18から入力されたアナログ音声信号に基づいて音声を再生する。

The

制御部40は、チューナ部14、記録再生処理部29、入力信号処理部16、操作部24、受信部26、ディスクドライブ部27、HDD(Hard Disk Drive)20、図示しないネットワークインタフェース等とバスやインタフェースによって接続されており、これら各部の動作を制御する。また、制御部40は、視聴者による操作部24やリモートコントローラ25の操作に基づいて、制御部40に接続された上記各部を制御し、番組視聴、チャンネル切替、番組の録画予約、映像コンテンツ等の処理を行う。

The

また、制御部40は、図2に示すように、CPU(Central Processing Unit)40aと、CPU40aが実行する制御プログラムを格納したROM(Read Only Memory)40bと、該CPU40aに作業エリアを提供するためのRAM(Random Access Memory)40cとを備えている。

Further, as shown in FIG. 2, the

ここで、カメラ4が撮影するカメラ映像と、ディスプレイ3が表示する表示映像の位置ずれについて説明する。図3は、カメラ4が撮影するカメラ映像と、ディスプレイ3が表示する表示映像の位置ずれの一例を説明する図である。まず、カメラ4によって撮影されるカメラ映像の中心位置は、カメラ4のレンズの中心位置となり、ディスプレイ3が表示する表示映像の中心位置は、ディスプレイ3の中心位置となるため、これらの中心位置はディスプレイ3の幅に応じて離間することとなる。また、図3に示すように、カメラ4の光軸はディスプレイ3の前の視聴者を撮影できるようディスプレイ3の中心寄りに傾けて設置される。従って、カメラ4のレンズ表面の法線ベクトル51と、ディスプレイ表面の法線ベクトル52とは異なる方向を向くこととなる。従って、カメラ映像をディスプレイ3に表示する場合には、これらカメラ映像とディスプレイ3の表示映像との相対的位置関係に応じて、位置や方向のずれを補正する必要がある。また、カメラ4をテレビジョン装置1に設置する際にはその位置に個体差が生じる場合もあるため、カメラ4の設置位置や設置方向を各々のテレビジョン装置1で補正する必要がある。

Here, the camera video camera 4 shoots, the positional deviation of a display image that the

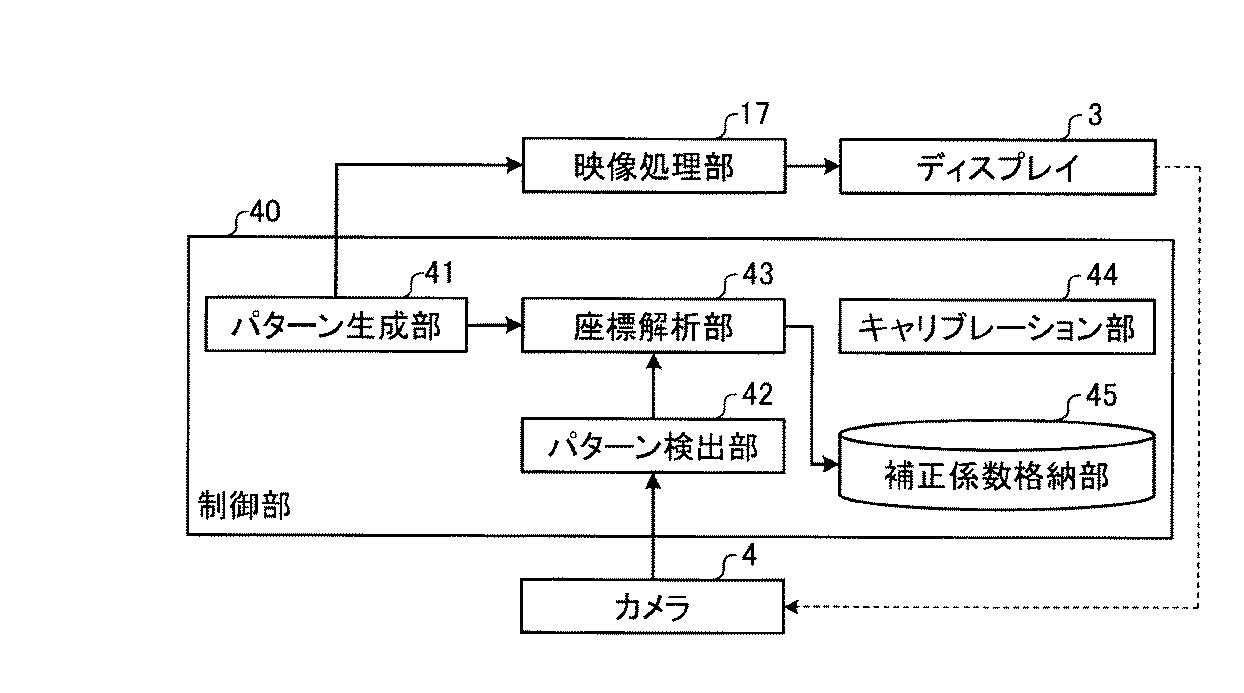

図4は、テレビジョン装置1が有するソフトウェア構成を示すブロック図である。制御部40(図2参照)は、制御部40が備えるCPU40aがROM40bに格納されたプログラムをRAM40cに展開して実行することにより、図4に示すように、パターン生成部41、パターン検出部42、座標解析部43、キャリブレーション部44としての機能を実現する。また、制御部40の不揮発性の記憶エリアには、補正係数格納部45が設けられている。次に、各部の機能について概略的に説明する。

FIG. 4 is a block diagram showing a software configuration of the television device 1. The control unit 40 (see FIG. 2) is configured such that the

パターン生成部41は、キャリブレーション用のパターン画像を生成する。パターン検出部42は、鏡に描画されたキャリブレーション用のパターン画像、または、ディスプレイ3に表示されたパターン画像を鏡に映し出させたパターン画像の鏡像を検出する。

The pattern generation unit 41 generates a pattern image for calibration. The

座標解析部43は、カメラ映像における座標(x、y、z)とディスプレイ3の表示映像における座標(Xp、Yp、Zp)との相対的関係をアフィン変換によって求め、アフィン変換の変換行列を補正係数として補正係数格納部45に格納する。アフィン変換とは、元の図形を変形させずに平行移動や回転をさせる変換であり、元の図形上の座標と変換後の図形上の座標との相対的位置関係は、変換係数によって線形関係に表される。また、アフィン変換には、縦方向と横方向とで拡大または縮小の倍率が異なる変換や、図形を左右反転、上下反転させる変換も含まれる。

The coordinate

即ち、カメラ映像における任意の点の座標(x、y、z)と、ディスプレイ3の表示映像において上記任意点に対応させる座標(Xp、Yp、Zp)との相対的位置関係を、アフィン変換の変換行列Rを用いて示すと、次式1のように表される。

(x、y、z)=R(Xp、Yp、Zp) (式1)

変換行列Rは、本実施形態においてカメラ映像とディスプレイ3の表示映像とを補正する際に用いられる補正係数であり、本実施形態の補正係数算出処理は、座標解析部43が変換行列Rを算出する処理のことをいう。

That is, the relative positional relationship between the coordinates (x, y, z) of an arbitrary point in the camera image and the coordinates (Xp, Yp, Zp) corresponding to the arbitrary point in the display image of the

(X, y, z) = R (Xp, Yp, Zp) (Formula 1)

The conversion matrix R is a correction coefficient used when correcting the camera image and the display image on the

キャリブレーション部44は、補正係数格納部45に格納された補正係数によってカメラ映像を補正し、補正後の映像をディスプレイ3に表示させる。尚、各部のより詳細な機能については後述する。

The

次に、テレビジョン装置1が行う補正係数算出処理について、図4および図5を参照して説明する。図4のブロック図は、テレビジョン装置1がカメラ映像のキャリブレーションに用いる補正係数を算出する場合の動作を示している。また、図5はテレビジョン装置1が行う補正係数算出処理の手順を示すフローチャートである。 Next, correction coefficient calculation processing performed by the television device 1 will be described with reference to FIGS. 4 and 5. The block diagram of FIG. 4 shows an operation when the television apparatus 1 calculates a correction coefficient used for camera image calibration. FIG. 5 is a flowchart showing a procedure of correction coefficient calculation processing performed by the television apparatus 1.

まず、ディスプレイ3と鏡6とを正対させるようテレビジョン装置1を鏡6の前に設置する(ステップS1)。尚、テレビジョン装置1と鏡6とはどちら側を移動させてもよく、テレビジョン装置1の前に鏡6を設置するとしてもよい。また、テレビジョン装置1と鏡6との相対的位置関係は、ステップS2において補正されるため、ステップS1ではテレビジョン装置1と鏡6とをおよそ平行となるように設置すればよい。尚、テレビジョン装置1と鏡6とが厳密に平行である場合には、ステップS2の手順を省略することができる。

First, the television apparatus 1 is installed in front of the mirror 6 so that the

次に、テレビジョン装置1は、ディスプレイ3に設けられたカメラ4と鏡6との相対的位置関係を算出する(ステップS2)。 Next, the television apparatus 1 calculates the relative positional relationship between the camera 4 and the mirror 6 provided on the display 3 (step S2).

図6は、カメラ4と鏡6との相対的位置関係の算出方法を説明する図である。図6に示すように、補正係数算出処理において用いられる鏡6には、キャリブレーション用のパターン画像としてプリントパターン61が描かれている。パターン検出部42は、カメラ4で撮影されたこのプリントパターン61のカメラ映像32において、パターンの格子点P11、P12、P13、P14、…の座標を検出する。

FIG. 6 is a diagram for explaining a method for calculating the relative positional relationship between the camera 4 and the mirror 6. As shown in FIG. 6, a

図6において、点線で示される基準パターン31は、カメラ4と鏡6が正対している場合に撮影されるべきパターン画像である。基準パターン31の各格子点の座標は、プリントパターン61における各格子点の座標に対応しており、予め記憶部(補正係数格納部45)に格納されている。基準パターン31の座標は、座標の参照値として、カメラ4が検出したパターン画像との比較に用いられる。以下では、プリントパターン61における座標と基準パターン31における座標が1対1に対応している例について説明する。

In FIG. 6, a

座標解析部43は、プリントパターン61のカメラ映像32における格子点P11、P12、P13、P14、…の検出座標(第2検出座標)と、基準パターン31において上記各格子点に対応する格子点P1、P2、P3、P4、…の座標とを比較し、これらの間の相対的位置関係をアフィン変換を用いてそれぞれ算出する。尚、座標解析部43は、最も近い格子点P11〜P14と格子点P1〜P4同士を対応付けて比較する。

The coordinate

図7は、アフィン変換による座標変換を説明する図である。図7に示すように、カメラ映像32における各格子点の座標(x、y、z)と、鏡6のプリントパターン61(すなわち基準パターン31)における各格子点の座標(Xm、Ym、Zm)との相対的関係を変換行列R1(第2補正係数)を用いて示すと、次式2のように表せる。

(x、y、z)=R1(Xm、Ym、Zm) (式2)

FIG. 7 is a diagram for explaining coordinate transformation by affine transformation. As shown in FIG. 7, the coordinates (x, y, z) of each grid point in the

(X, y, z) = R1 (Xm, Ym, Zm) (Formula 2)

より具体的には、格子点座標(Xm、Ym、Zm)、(x、y、z)の間において、x軸方向の回転角をα、y軸方向の回転角をβ、z軸方向の回転角をγ、x軸方向の平行移動量をTx、y軸方向の平行移動量をTy、z軸方向の平行移動量をTzとすると、変換行列R1は以下のように4行4列の行列を4組並べた行列式で表される。 More specifically, between the lattice point coordinates (Xm, Ym, Zm) and (x, y, z), the rotation angle in the x-axis direction is α, the rotation angle in the y-axis direction is β, and the rotation angle in the z-axis direction is When the rotation angle is γ, the translation amount in the x-axis direction is Tx, the translation amount in the y-axis direction is Ty, and the translation amount in the z-axis direction is Tz, the transformation matrix R1 has 4 rows and 4 columns as follows. It is expressed by a determinant in which four sets of matrices are arranged.

式3において、1番目の行列はZ軸回転を示し、2番目の行列はY軸回転を示し、3番目の行列はX軸回転を示し、4番目の行列はXYZ各軸方向の平行移動を示す。

In

座標解析部43(算出手段)は、格子点座標(Xm、Ym、Zm)、(x、y、z)の組み合わせを複数組用いて式3の連立方程式を立て、この解を得ることによって式3の変換行列R1に含まれる複数の未知数を算出する。これにより、座標解析部43は、上記式2における変換行列R1を算出することができる。即ち、式3で算出された各回転角α、β、γ、および各平行移動量Tx、Ty、Tzを用いてアフィン変換すれば、テレビジョン装置1は、カメラ4と鏡6の相対的位置関係を補正して、カメラ4と鏡6とが平行となった状態を仮想的に実現することができる。

The coordinate analysis unit 43 (calculation means) establishes simultaneous equations of

次に、テレビジョン装置1は、鏡6と鏡像7(図7参照)との相対的位置関係を算出する(ステップS3)。 Next, the television apparatus 1 calculates the relative positional relationship between the mirror 6 and the mirror image 7 (see FIG. 7) (step S3).

図8は、鏡6と鏡像7との相対的位置関係の算出方法を説明する図である。パターン生成部41は、カメラ映像のキャリブレーションに用いるパターン画像として基準パターン31を生成し、映像処理部17に基準パターン31の座標情報を出力する。パターン生成部41は一例として、基準パターン31の格子点P1、P2、P3、P4、…の座標をそれぞれ、基準パターン31を表示する際に基準とする座標として映像処理部17に出力する。映像処理部17は、この座標情報に基づいてディスプレイ3に基準パターン31を表示させる。このように、パターン生成部41と映像処理部17とは第1表示手段として機能する。また、パターン生成部41は、基準パターン31の格子点P1、P2、P3、P4、…の表示座標を座標解析部43に出力する。尚、以下では、ディスプレイ3に表示された基準パターン31を、表示パターン31という場合がある。

FIG. 8 is a diagram for explaining a method for calculating the relative positional relationship between the mirror 6 and the mirror image 7. The pattern generation unit 41 generates the

尚、パターン生成部41が生成する表示パターン31は、図8では一点鎖線で示したが、これに限定されるものではない。プリントパターン61と異なる色の線で表示パターン31を表示させるとしてもよい。

Note that the

パターン検出部42(検出手段、第2検出手段)は、鏡6に映し出された表示パターン31の鏡像をカメラ4で撮影して得られたカメラ映像において表示パターン31の鏡像である鏡像パターン33を検出する。また、パターン検出部42は、鏡像パターン33における格子点P21、P22、P23、P24、…の座標(第2検出座標)を検出し取得する。

The pattern detection unit 42 (detection means, second detection means) displays a

座標解析部43は、鏡像パターン33の格子点P21、P22、P23、P24、…の検出座標と、パターン生成部41から入力された基準パターン31の格子点P1、P2、P3、P4、…の表示座標とを比較し、これらの間の相対的位置関係をアフィン変換を用いて算出する。

The coordinate

図7に示すように、鏡6のプリントパターン61における格子点座標(Xm、Ym、Zm)と、表示パターン31の鏡像7(鏡像パターン33)における座標(Xp’、Yp’、Zp’)との相対的関係を、アフィン変換の変換行列R2を用いて示すと、次式4のように表せる。

(Xm、Ym、Zm)=R2(Xp’、Yp’、Zp’) (式4)

As shown in FIG. 7, the grid point coordinates (Xm, Ym, Zm) in the

(Xm, Ym, Zm) = R2 (Xp ′, Yp ′, Zp ′) (Formula 4)

より具体的には、格子点座標(Xm、Ym、Zm)、(Xp’、Yp’、Zp’)の間において、x軸方向の回転角をδ、y軸方向の回転角をε、z軸方向の回転角をζ、x軸方向の平行移動量をTx’、y軸方向の平行移動量をTy’、z軸方向の平行移動量をTz’とすると、変換行列R2は次式5のように4行4列の行列を4組並べた行列式で表される。 More specifically, between the lattice point coordinates (Xm, Ym, Zm) and (Xp ′, Yp ′, Zp ′), the rotation angle in the x-axis direction is δ, and the rotation angle in the y-axis direction is ε, z If the rotation angle in the axial direction is ζ, the translation amount in the x-axis direction is Tx ′, the translation amount in the y-axis direction is Ty ′, and the translation amount in the z-axis direction is Tz ′, the transformation matrix R2 is As shown by a determinant in which four sets of 4 × 4 matrices are arranged.

式5において、1番目の行列はZ軸回転を示し、2番目の行列はY軸回転を示し、3番目の行列はX軸回転を示し、4番目の行列はXYZ各軸方向の平行移動を示す。

In

座標解析部43は、格子点座標(Xm、Ym、Zm)、(Xp’、Yp’、Zp’)の組み合わせを複数組用いて式5の連立方程式を立て、この解を得ることによって式5の変換行列R2に含まれる複数の未知数を算出する。これにより、座標解析部43は、上記式5における変換行列R2を算出することができる。

The coordinate

次に、座標解析部43は、鏡像7(図7参照)の座標系をディスプレイ3の表示座標系に変換する(ステップS4)。ここで、ディスプレイ3の表示座標系で表される座標としては、例えば、表示パターン31(即ち基準パターン31)の格子点P1、P2、P3、P4、…の座標(Xp、Yp、Zp)がある。

Next, the coordinate

図7に示すように、鏡6のプリントパターン61における格子点座標(Xm、Ym、Zm)と、表示パターン31における格子点座標(Xp、Yp、Zp)との相対的関係は、変換行列R3を用いて次式6のように表せる。

(Xm、Ym、Zm)=R3(Xp、Yp、Zp) (式6)

As shown in FIG. 7, the relative relationship between the grid point coordinates (Xm, Ym, Zm) in the

(Xm, Ym, Zm) = R3 (Xp, Yp, Zp) (Formula 6)

ここで、鏡像パターン33の格子点座標(Xp’、Yp’、Zp’)とディスプレイ3の表示座標(Xp、Yp、Zp)との関係は、鏡像反転の関係である。つまり、図7において、ディスプレイ3と鏡像7とは鏡6に対して鏡像対称である。式5とともに上述したように、鏡6における座標系(Xm、Ym、Zm)は、鏡像7における座標系(Xp’、Yp’、Zp’)に対して、x、y、z軸それぞれに対してδ、ε、ζだけ回転されている。従って、鏡像7における座標系(Xp’、Yp’、Zp’)は、鏡6における座標系(Xm、Ym、Zm)に対して、x、y、z軸それぞれに対して−δ、−ε、ζだけ回転されていることとなる。

Here, the relationship between the lattice point coordinates (Xp ′, Yp ′, Zp ′) of the

従って、座標解析部43は、式5の変換行列R2において、X軸回転およびY軸回転の回転角の符号をそれぞれ反転してマイナス(−)とすることにより変換行列R3を次式7によって求めることができる。

Accordingly, the coordinate

図9は、カメラ映像における座標(x、y、z)と、ディスプレイ3の表示座標(Xp、Yp、Zp)との相対的位置関係を説明する図である。座標解析部43は、式3で算出された変換行列R1と、式7によって算出された変換行列R3とを用いて、カメラ映像における座標(x、y、z)と、ディスプレイ3の表示座標(Xp、Yp、Zp)との相対的位置関係を算出する(ステップS5)。

FIG. 9 is a diagram for explaining the relative positional relationship between coordinates (x, y, z) in a camera image and display coordinates (Xp, Yp, Zp) on the

即ち、式2に式4を代入すると、カメラ映像における座標(x、y、z)と表示パターンにおける座標(Xp、Yp、Zp)との相対的関係は、次式8のように表される。

(x、y、z)=R1・R3(Xp、Yp、Zp) (式8)

従って、式1と式8とを比較すると、求めるべき変換行列Rは、R=R1・R3となる。式8は、より具体的には、式3と式7とにより次式9のように表される。

(X, y, z) = R1 · R3 (Xp, Yp, Zp) (Formula 8)

Therefore, when Equation 1 and Equation 8 are compared, the transformation matrix R to be obtained is R = R1 · R3. More specifically, Expression 8 is expressed as Expression 9 by

そして、座標解析部43は、ステップS1で算出した変換行列R1に含まれるα、β、γ、Tx、Ty、Tz、と、ステップS4で算出した変換行列R3に含まれるδ、ε、ζ、Tx’、Ty’、Tz’とを式9に代入することにより、変換行列Rを算出する(ステップS5)。そして、座標解析部43は、算出した変換行列Rを補正係数として補正係数格納部45に格納して(ステップS6)、補正係数算出処理を終了する。

The coordinate

次に、テレビジョン装置1が行う映像表示処理について図10および図11を参照して説明する。図10は、テレビジョン装置1が補正係数格納部45に格納された補正係数を用いてカメラ映像を補正し、ディスプレイ3に補正後のカメラ映像を表示させる場合の動作を示すブロック図である。また、図11は、テレビジョン装置1が行う映像表示処理の手順を示すフローチャートである。

Next, video display processing performed by the television device 1 will be described with reference to FIGS. 10 and 11. FIG. 10 is a block diagram illustrating an operation when the television apparatus 1 corrects the camera video using the correction coefficient stored in the correction

まず、テレビジョン装置1において、制御部40が撮影を開始させる撮影オン信号をカメラ4に出力すると、カメラ4は撮影を開始する(ステップS11)。キャリブレーション部44は、補正係数格納部45に格納されている補正係数(変換行列R)を用いて、カメラ4が撮影した映像(カメラ映像)を補正する(ステップS12)。キャリブレーション部44は、補正後のカメラ映像を映像処理部17に出力する。映像処理部17は、補正後のカメラ映像をディスプレイ3に表示させる(ステップS13)。このように、キャリブレーション部44と映像処理部17とは、第2表示手段として機能する。

First, in the television apparatus 1, when the

以上説明したとおり、本実施形態によれば、ディスプレイに表示させた図形を鏡に映し出し、鏡に映し出された図形をカメラで撮影して得られた鏡像の検出座標と、図形を表示させた表示座標とに基づいて、カメラ映像のディスプレイ上での表示座標を補正する。これにより、自装置と鏡があればキャリブレーションを行うことができるため、テレビジョン装置1に固定されているカメラのキャリブレーションを行い易い映像表示装置、映像表示方法およびプログラムを提供することができる。 As described above, according to the present embodiment, the figure displayed on the display is displayed on the mirror, the detected coordinates of the mirror image obtained by photographing the figure displayed on the mirror with the camera, and the display on which the figure is displayed. Based on the coordinates, the display coordinates of the camera image on the display are corrected. As a result, calibration can be performed if there is a self-device and a mirror. Therefore, it is possible to provide a video display device, a video display method, and a program that facilitate calibration of a camera fixed to the television device 1. .

尚、上述の式1ないし式3で示したアフィン変換において、カメラの光学系に関する各種パラメータを含めて上記各変換行列R1〜R3、Rを算出するとしてもよい。 In the affine transformation expressed by the above-described equations 1 to 3, the transformation matrices R1 to R3 and R may be calculated including various parameters related to the camera optical system.

また、上述では、表面に補正用のパターンがプリントされた鏡6を用いて補正係数を求めたが、鏡6とディスプレイ3が完全に平行に設置されている場合には、パターンをプリントしていない鏡を用いて補正係数算出処理を行うとしてもよい。この場合、上述の補正係数R1は不要(つまりR1=1)となるので、補正係数RはR=R3として算出すればよい。

In the above description, the correction coefficient is obtained by using the mirror 6 having the correction pattern printed on the surface. However, when the mirror 6 and the

また、鏡6にプリントされる図形とディスプレイ3に表示する図形は同一のものでなくてもよい。例えば、プリントパターンにおけるパターン間隔と、表示パターンにおけるパターン間隔とを異ならせるとしてもよい。また、プリントパターンでは格子点のみをプリントしたパターンとしてもよい。さらに、プリントパターンおよび表示パターンはその他の図形を用いてもよい。その他の図形として、例えばチェッカーボード(市松模様)のパターンを用いるとしてもよい。

Further, the graphic printed on the mirror 6 and the graphic displayed on the

なお、本実施形態のテレビジョン装置1で実行されるプログラムは、ROM等に予め組み込まれて提供される。本実施形態のテレビジョン装置1で実行されるプログラムは、インストール可能な形式又は実行可能な形式のファイルでCD−ROM、フレキシブルディスク(FD)、CD−R、DVD(DigiTal VersaTile Disk)等のコンピュータで読み取り可能な記録媒体に記録して提供するように構成してもよい。 Note that the program executed by the television apparatus 1 of the present embodiment is provided by being incorporated in advance in a ROM or the like. A program executed in the television apparatus 1 of the present embodiment is a file in an installable format or an executable format, and is a computer such as a CD-ROM, a flexible disk (FD), a CD-R, and a DVD (DigitalTalsaTile Disk). The information may be provided by being recorded on a recording medium that can be read by the user.

さらに、本実施形態のテレビジョン装置1で実行されるプログラムを、インターネット等のネットワークに接続されたコンピュータ上に格納し、ネットワーク経由でダウンロードさせることにより提供するように構成しても良い。また、本実施形態のテレビジョン装置1で実行されるプログラムをインターネット等のネットワーク経由で提供または配布するように構成しても良い。 Furthermore, the program executed by the television device 1 of the present embodiment may be provided by being stored on a computer connected to a network such as the Internet and downloaded via the network. Further, the program executed by the television apparatus 1 of the present embodiment may be provided or distributed via a network such as the Internet.

また、本実施形態の鏡6と上記プログラムとをカメラ映像のキャリブレーションキットとして提供するとしてもよい。また、本実施形態は、カメラを備えていないテレビジョン装置1に後付けでカメラを増設する場合に適用するとしてもよい。即ち、カメラを増設した場合に、上記の補正係数算出処理を行い、算出された補正係数を用いてカメラ映像のキャリブレーションを行うとしてもよい。 The mirror 6 of the present embodiment and the program may be provided as a camera video calibration kit. Further, the present embodiment may be applied to the case where a camera is added later to the television apparatus 1 that does not include a camera. That is, when the number of cameras is increased, the above-described correction coefficient calculation process may be performed, and camera video calibration may be performed using the calculated correction coefficient.

また、上述では、カメラ4がディスプレイ3に固定される場合について説明したが、カメラ4の取り付け箇所はこれに限定されるものではない。カメラ4はテレビジョン装置1の支持部5等、その他の箇所に取り付けられるとしてもよい。

Moreover, although the case where the camera 4 was fixed to the

また、上述では、ディスプレイ3と鏡6とを対向配置して補正係数算出処理を行うとしたが、ディスプレイ3と鏡6の配置関係はこれに限定されるものではない。その他の例として、ディスプレイ3と鏡6との間にパターンが描画されていない鏡等の光学系を新たに配置して、鏡6上のパターン画像をこの光学系によって回折させた後にカメラ4によって撮影するとしてもよい。

In the above description, the correction coefficient calculation process is performed by arranging the

尚、上述では、本実施形態の映像表示装置をテレビジョン装置1に適用した例について説明したが、本実施形態はこれに限定されるものではなく、PC等の情報処理装置や各種ディスプレイ装置に適用してもよい。また、上述では、テレビジョン装置1が平面視表示タイプである場合について説明したが、本実施形態を立体視表示タイプのテレビジョン装置に適用するとしてもよい。 In addition, although the example which applied the video display apparatus of this embodiment to the television apparatus 1 was demonstrated above, this embodiment is not limited to this, Information processing apparatus, such as PC, and various display apparatuses You may apply. In the above description, the case where the television apparatus 1 is a planar display type has been described. However, the present embodiment may be applied to a stereoscopic display type television apparatus.

また、本実施形態の適用例として、カメラ映像において検出された人の位置や顔の位置を、本実施形態の補正係数を用いて補正してディスプレイ3に表示するとしてもよい。

As an application example of the present embodiment, the position of a person or face detected in a camera image may be corrected using the correction coefficient of the present embodiment and displayed on the

本発明のいくつかの実施形態を説明したが、これらの実施形態は、例として提示したものであり、発明の範囲を限定することは意図していない。これら新規な実施形態は、その他の様々な形態で実施されることが可能であり、発明の要旨を逸脱しない範囲で、種々の省略、置き換え、変更を行うことができる。これら実施形態やその変形は、発明の範囲や要旨に含まれるとともに、特許請求の範囲に記載された発明とその均等の範囲に含まれる。 Although several embodiments of the present invention have been described, these embodiments are presented by way of example and are not intended to limit the scope of the invention. These novel embodiments can be implemented in various other forms, and various omissions, replacements, and changes can be made without departing from the scope of the invention. These embodiments and modifications thereof are included in the scope and gist of the invention, and are included in the invention described in the claims and the equivalents thereof.

1…テレビジョン装置、2…筐体、3…ディスプレイ、4…カメラ、5…支持部、6…鏡、7…鏡像、24…操作部、31…基準パターン(表示パターン)、32…カメラ映像、33…鏡像パターン、40…制御部、41…パターン生成部、42…パターン検出部、43…座標解析部、44…キャリブレーション部、45…補正係数格納部、51…法線ベクトル、52…法線ベクトル、61…プリントパターン DESCRIPTION OF SYMBOLS 1 ... Television apparatus, 2 ... Housing | casing, 3 ... Display, 4 ... Camera, 5 ... Support part, 6 ... Mirror, 7 ... Mirror image, 24 ... Operation part, 31 ... Reference pattern (display pattern), 32 ... Camera image , 33 ... mirror image pattern, 40 ... control unit, 41 ... pattern generation unit, 42 ... pattern detection unit, 43 ... coordinate analysis unit, 44 ... calibration unit, 45 ... correction coefficient storage unit, 51 ... normal vector, 52 ... Normal vector, 61 ... Print pattern

Claims (9)

ディスプレイと、

前記ディスプレイに所定の表示座標を基準として所定の図形を表示させる第1表示手段と、

鏡に映し出された前記図形の鏡像を前記カメラで撮影して得られたカメラ映像上において、前記鏡像を検出した検出座標を取得する検出手段と、

前記所定の図形の表示座標と前記鏡像の検出座標との相対的位置関係に基づいて、前記カメラで撮影されたカメラ映像における座標を前記ディスプレイの表示座標に対応させるための補正係数を算出する算出手段と、

カメラ映像に含まれている人の顔の位置を検出する位置検出手段と、

前記ディスプレイの表示座標に対する前記顔の位置を前記補正係数によって補正する補正手段と、

を備える映像表示装置。 And the camera,

And de-Isupurei,

A first display means for displaying the predetermined graphic reference to a predetermined display coordinates on the display,

On the camera image obtained by photographing the mirror image of the figure projected on the mirror with the camera, detection means for acquiring detection coordinates for detecting the mirror image;

Based on the relative positional relationship between the detected coordinates of the mirror image and the display coordinates of the predetermined graphic, the coordinates in the captured camera images in the camera to calculate a correction coefficient of order to correspond to the display coordinates of the display A calculation means;

Position detecting means for detecting the position of a human face included in the camera image;

Correction means for correcting the position of the face with respect to the display coordinates of the display by the correction coefficient ;

A video display device comprising:

前記算出手段は、前記所定の図形の表示座標と前記第2検出座標との相対的位置関係に基づいて、前記カメラと前記鏡との相対的位置関係を補正する第2補正係数を算出し、当該第2補正係数を用いて前記補正係数を算出する、請求項1または2に記載の映像表示装置。 The detection means further detects, as second detection coordinates, detection coordinates at which the figure is detected on a camera image obtained by photographing the predetermined figure drawn on the mirror,

The calculating means calculates a second correction coefficient for correcting the relative positional relationship between the camera and the mirror based on the relative positional relationship between the display coordinates of the predetermined graphic and the second detection coordinates; calculating the correction coefficient using the second correction coefficient, the image display device according to claim 1 or 2.

前記検出手段は、前記鏡に映し出された前記格子状のパターンの鏡像を前記カメラで撮影して得られたカメラ映像において、各格子点の検出座標を検出し、

前記算出手段は、前記複数の点座標と、当該点座標に対応する前記各格子点の検出座標との相対的位置関係に基づいて前記補正係数を算出する、請求項1または2に記載の映像表示装置。 The first display means displays a lattice-like pattern having lattice points at a plurality of point coordinates on the display as the predetermined figure ,

The detecting device, the camera image obtained a mirror image of the lattice pattern projected on the said mirror and captured by the camera, detects the detected coordinates of each grid point,

The calculating means, the plurality of point coordinates, and calculates the correction factor based on the relative positional relationship between the detected coordinates of the grid points corresponding to the point coordinates, the image according to claim 1 or 2 Display device.

ディスプレイと、

前記ディスプレイに所定の表示座標を基準として所定の図形を表示させて、鏡に映し出された前記図形の鏡像を前記カメラで撮影して得られたカメラ映像上において、前記図形の鏡像の検出座標を検出し、前記所定の図形の表示座標と前記鏡像の検出座標との相対的位置関係に基づいて算出された、前記カメラで撮影されたカメラ映像における座標を前記ディスプレイの表示座標に対応させるための補正係数を記憶する記憶手段と、

カメラ映像に含まれている人の顔の位置を検出する位置検出手段と、

前記ディスプレイの表示座標に対する前記顔の位置を前記補正係数によって補正する補正手段と、

を備える映像表示装置。 And the camera,

And de-Isupurei,

Wherein to display predetermined graphic reference to a predetermined display coordinates on the display, on a camera image obtained a mirror image of the figure projected on the mirror taken with the camera, the detected coordinates of the mirror image of the figure detect, because in correspondence said calculated based predetermined display coordinates of the graphics and the relative positional relationship between the detected coordinates of the mirror image, the coordinates in the captured camera images in the camera to the display coordinates of the display Storage means for storing the correction coefficient of

Position detecting means for detecting the position of a human face included in the camera image;

Correction means for correcting the position of the face with respect to the display coordinates of the display by the correction coefficient ;

A video display device comprising:

ディスプレイと、

前記ディスプレイに所定の表示座標を基準として所定の図形を表示させて、鏡に映し出された前記図形の鏡像を前記カメラで撮影して得られたカメラ映像上において、前記鏡像を検出した検出座標を取得し、前記所定の図形の表示座標と前記鏡像の検出座標との相対的位置関係に基づいて算出された、前記カメラで撮影されたカメラ映像における座標を前記ディスプレイの表示座標に対応させるための補正係数を記憶する記憶部と、を備える映像表示装置において、

カメラ映像に含まれている人の顔の位置を検出する位置検出工程と、

前記ディスプレイの表示座標に対する前記顔の位置を前記補正係数によって補正する補正工程と、を含む映像表示方法。 And the camera,

And de-Isupurei,

Wherein to display predetermined graphic reference to a predetermined display coordinates on the display, on a camera image obtained a mirror image of the figure projected on the mirror taken with the camera, the detection coordinates detected the mirror image acquired, because in correspondence said calculated based predetermined display coordinates of the graphics and the relative positional relationship between the detected coordinates of the mirror image, the coordinates in the captured camera images in the camera to the display coordinates of the display A video display device comprising: a storage unit that stores the correction coefficient of

A position detection step for detecting the position of a human face included in the camera image;

A correction step of correcting the position of the face with respect to the display coordinates of the display by the correction coefficient.

ディスプレイと、

前記ディスプレイに所定の表示座標を基準として所定の図形を表示させて、鏡に映し出された前記図形の鏡像を前記カメラで撮影して得られたカメラ映像上において、前記鏡像を検出した検出座標を取得し、前記所定の図形の表示座標と前記鏡像の検出座標との相対的位置関係に基づいて算出された、前記カメラで撮影されたカメラ映像における座標を前記ディスプレイの表示座標に対応させるための補正係数を記憶する記憶部と、を備える映像表示装置を制御するコンピュータを、

カメラ映像に含まれている人の顔の位置を検出する位置検出手段と、

前記ディスプレイの表示座標に対する前記顔の位置を前記補正係数によって補正する補正手段と、として機能させるためのプログラム。 And the camera,

And de-Isupurei,

Wherein to display predetermined graphic reference to a predetermined display coordinates on the display, on a camera image obtained a mirror image of the figure projected on the mirror taken with the camera, the detection coordinates detected the mirror image acquired, because in correspondence said calculated based predetermined display coordinates of the graphics and the relative positional relationship between the detected coordinates of the mirror image, the coordinates in the captured camera images in the camera to the display coordinates of the display A computer that controls the video display device, the storage unit storing the correction coefficient of

Position detecting means for detecting the position of a human face included in the camera image;

A program for functioning as correction means for correcting the position of the face with respect to the display coordinates of the display by the correction coefficient.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011146374A JP5453352B2 (en) | 2011-06-30 | 2011-06-30 | Video display device, video display method and program |

| CN201210057450.5A CN102857785B (en) | 2011-06-30 | 2012-03-06 | Video display device and video display method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011146374A JP5453352B2 (en) | 2011-06-30 | 2011-06-30 | Video display device, video display method and program |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2013015324A JP2013015324A (en) | 2013-01-24 |

| JP5453352B2 true JP5453352B2 (en) | 2014-03-26 |

Family

ID=47403920

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011146374A Expired - Fee Related JP5453352B2 (en) | 2011-06-30 | 2011-06-30 | Video display device, video display method and program |

Country Status (2)

| Country | Link |

|---|---|

| JP (1) | JP5453352B2 (en) |

| CN (1) | CN102857785B (en) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9838587B2 (en) | 2015-06-22 | 2017-12-05 | Center Of Human-Centered Interaction For Coexistence | System for registration of virtual space and real space, method for registering display apparatus and image sensor, and electronic device registered using the method |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN103985330A (en) * | 2013-04-07 | 2014-08-13 | 迟鹏 | Mirroring production method of article or video |

| KR101496441B1 (en) | 2013-11-01 | 2015-02-27 | 한국과학기술연구원 | Apparatus and Method for registration of flat panel display device and imaging sensor, and Electronic device having flat panel display device and imaging sensor which are registered using the method |

| KR101615086B1 (en) | 2014-05-29 | 2016-04-27 | 주식회사 고영테크놀러지 | Optical tracking system and method of calculating orientation of marker part of optical tracking system |

| US20160111062A1 (en) * | 2014-10-15 | 2016-04-21 | Intel Corporation | Ambient light-based image adjustment |

| CN104536458A (en) * | 2014-12-22 | 2015-04-22 | 中国人民解放军海军航空工程学院青岛校区 | Portable flight parameter data calibration method and device |

| JP6302427B2 (en) * | 2015-04-02 | 2018-03-28 | 日本電信電話株式会社 | Image data processing method, image data processing apparatus, and image data processing program |

| US10401145B2 (en) * | 2016-06-13 | 2019-09-03 | Carl Zeiss Industrielle Messtechnik Gmbh | Method for calibrating an optical arrangement |

| CN106791817B (en) * | 2016-12-27 | 2019-03-15 | 歌尔股份有限公司 | The assemble method of camera lens and image sensor to be assembled |

| JP6926486B2 (en) * | 2017-01-20 | 2021-08-25 | 沖電気工業株式会社 | Information processing equipment, information processing methods and programs |

| CN107749981B (en) * | 2017-11-15 | 2024-01-30 | 歌尔光学科技有限公司 | Camera field angle measurement method and system |

| KR102168720B1 (en) * | 2018-07-24 | 2020-10-22 | 엘지디스플레이 주식회사 | display device having a mirror function |

Family Cites Families (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0797024B2 (en) * | 1987-12-22 | 1995-10-18 | 旭硝子株式会社 | Reflection image distortion measurement method |

| US5510833A (en) * | 1994-06-13 | 1996-04-23 | Display Laboratories Inc. | Method and apparatus for transforming coordinate systems in an automated video monitor alignment system |

| JP3340296B2 (en) * | 1995-12-27 | 2002-11-05 | 株式会社東海理化電機製作所 | Distortion inspection method and distortion inspection device |

| JP4453119B2 (en) * | 1999-06-08 | 2010-04-21 | ソニー株式会社 | Camera calibration apparatus and method, image processing apparatus and method, program providing medium, and camera |

| KR100414083B1 (en) * | 1999-12-18 | 2004-01-07 | 엘지전자 주식회사 | Method for compensating image distortion and image displaying apparatus using the same |

| JP3906194B2 (en) * | 2002-11-29 | 2007-04-18 | 株式会社東芝 | CALIBRATION METHOD, CALIBRATION SUPPORT DEVICE, CALIBRATION DEVICE, AND CAMERA SYSTEM MANUFACTURING METHOD |

| KR100571219B1 (en) * | 2003-01-08 | 2006-04-13 | 엘지전자 주식회사 | Digital convergence device based on 3-d virtual screen of video display system |

| JP2005020314A (en) * | 2003-06-25 | 2005-01-20 | Olympus Corp | Calculating method, calculating program and calculating apparatus for display characteristic correction data |

| JP3827662B2 (en) * | 2003-09-10 | 2006-09-27 | Necビューテクノロジー株式会社 | Projection display |

| JP4998711B2 (en) * | 2007-03-12 | 2012-08-15 | Jfeスチール株式会社 | Apparatus and method for measuring surface distortion |

| JP2009042162A (en) * | 2007-08-10 | 2009-02-26 | Toshiba Corp | Calibration device and method therefor |

| JP2010250452A (en) * | 2009-04-14 | 2010-11-04 | Tokyo Univ Of Science | Arbitrary viewpoint image synthesizing device |

| EP2427096B1 (en) * | 2009-05-09 | 2022-01-19 | Genentech, Inc. | Handheld vision tester and calibration thereof |

-

2011

- 2011-06-30 JP JP2011146374A patent/JP5453352B2/en not_active Expired - Fee Related

-

2012

- 2012-03-06 CN CN201210057450.5A patent/CN102857785B/en not_active Expired - Fee Related

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9838587B2 (en) | 2015-06-22 | 2017-12-05 | Center Of Human-Centered Interaction For Coexistence | System for registration of virtual space and real space, method for registering display apparatus and image sensor, and electronic device registered using the method |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2013015324A (en) | 2013-01-24 |

| CN102857785A (en) | 2013-01-02 |

| CN102857785B (en) | 2014-11-26 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5453352B2 (en) | Video display device, video display method and program | |

| JP5185424B1 (en) | Calibration method and video display device | |

| US9071751B2 (en) | Image processor method and program for correcting distance distortion in panorama images | |

| JP4310645B2 (en) | Method for correcting distortion of captured image signal and distortion correction apparatus for captured image signal | |

| US8036482B2 (en) | Image processing apparatus and method, program, and recording medium | |

| JP6035947B2 (en) | Image display device, image display method, and image display program | |

| JP2007180734A (en) | Image processor, camera system, image processing method and moving image display method | |

| US7441906B1 (en) | Keystone correction system and method | |

| JP2017050616A (en) | Display unit and control method | |

| JP5812593B2 (en) | VIDEO PROCESSING DEVICE, IMAGING DEVICE, VIDEO PROCESSING METHOD, AND PROGRAM | |

| JP2002014611A (en) | Video projecting method to planetarium or spherical screen and device therefor | |

| US11218662B2 (en) | Image processing device, image processing method, and projection system | |

| JP2007202177A (en) | Projector and multi-projection display | |

| EP2624209A1 (en) | Position coordinate detecting device, a position coordinate detecting method, and electronic device | |

| JP6515512B2 (en) | Display device, display device calibration method, and calibration program | |

| JP3757979B2 (en) | Video display system | |

| WO2018173797A1 (en) | Projector, projection method, image processing system, and method | |

| JP2000081593A (en) | Projection type display device and video system using the same | |

| JP4446080B2 (en) | Image display device having distortion correction function in image display | |

| WO2017104102A1 (en) | Imaging device | |

| JP5954987B2 (en) | Imaging apparatus and processing method thereof | |

| JP4168024B2 (en) | Stack projection apparatus and adjustment method thereof | |

| JP2019071522A (en) | Imaging apparatus and control method | |

| JP2017069920A (en) | Free viewpoint image data production device and free viewpoint image data reproduction device | |

| JP2014160998A (en) | Image processing system, image processing method, image processing program and recording medium |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20140106 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 5453352 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313115 Free format text: JAPANESE INTERMEDIATE CODE: R313121 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313117 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| LAPS | Cancellation because of no payment of annual fees |