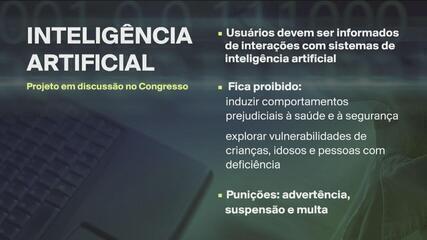

Senado quer regulamentar inteligência artificial

O presidente do Senado, Rodrigo Pacheco (PSD-MG), apresentou nesta quarta-feira (3) um projeto que regulamenta no Brasil o uso de sistemas de inteligência artificial (IA), como o ChatGPT.

A proposta prevê uma multa de até R$ 50 milhões para cada violação cometida pelas empresas de tecnologia e as enquadra nas punições da Lei Geral de Proteção de Dados Pessoais (LGPD), de 2018.

O texto também impede as companhias de se aproveitarem da condição vulnerável de alguns tipos de consumidores, como crianças, adolescentes e pessoas com deficiência.

Conheça o ChatGPT, a tecnologia que viralizou por ter resposta para (quase) tudo

LEIA TAMBÉM:

- ChatGPT: conheça o robô conversador que viralizou por ter resposta para (quase) tudo

- GPT-4: OpenAI lança versão mais avançada de modelo que serve de base para o ChatGPT

- O alerta de especialistas sobre os riscos da inteligência artificial para a humanidade

- O 'padrinho' da inteligência artificial que se demitiu do Google e adverte sobre perigos da tecnologia

Países da União Europeia já manifestaram preocupação quanto à possibilidade de acesso e uso indiscriminado de dados pessoais pelas chamadas big techs e ausência de filtros para verificar a idade dos usuários.

A Itália chegou a bloquear o robô ChatGPT pela suspeita de falta de proteção dos consumidores no tratamento dos dados pessoais.

O texto vai passar ainda por uma comissão temática do Senado, que pode ser a de Ciência, Tecnologia e Informática (CCT), ou por um colegiado a ser criado especificamente para discutir a matéria.

Depois, a proposta será votada pelo plenário e, se aprovada, seguirá para a análise da Câmara dos Deputados. Eduardo Gomes (PL-TO) é cotado para ser o relator no Senado.

Punições

Segundo o texto, um órgão ligado à Presidência da República deve ser criado para acompanhar as atividades das empresas no Brasil e fiscalizar o cumprimento da lei.

Essa agência vai elaborar e implementar a "Estratégia Brasileira de Inteligência Artificial".

A empresa que quiser funcionar no Brasil terá de passar por uma avaliação. Será analisado o impacto do algoritmo da plataforma, o que identifica e direciona o usuário para suas preferências de produto ou conteúdo. O órgão do governo vai estabelecer os casos em que será necessária uma auditoria para avaliar esse impacto, ou seja, a ida de um técnico externo à empresa para aferir os riscos da tecnologia.

"Previamente a sua colocação no mercado ou utilização em serviço, todo sistema de inteligência artificial passará por avaliação preliminar realizada pelo fornecedor para classificação de seu grau de risco", diz o texto.

Inteligência artificial pode ter sentimentos? Veja o que a ciência diz sobre robô do ChatGPT que fez declaração de amor para humano

O que o projeto proíbe:

- plataformas de utilizarem técnicas para induzir os usuários a prejudicar a própria saúde ou segurança- por mensagens subliminares, por exemplo;

- empresas de explorar alguma vulnerabilidade dos consumidores, como deficientes e idosos, a convencer esse público a agir contra a própria saúde;

- o governo de avaliar, pelo comportamento dos usuários na rede social, pessoas que terão direito ou não a políticas públicas, programas sociais.

As empresas que não respeitarem as regras, estarão sujeitas a:

- multa equivalente a 2% do faturamento da empresa no ano anterior, com o limite de R$ 50 milhões para cada infração;

- proibição de participar por cinco anos de projetos experimentais de inovação, chamados de "sandbox regulatório";

- suspensão das atividades da empresa, do desenvolvimento e operação da ferramenta de inteligência artificial;

- proibição de tratamento de determinadas bases de dados.

Pela proposta, a Justiça deverá considerar a condição econômica e se a empresa cometeu outros crimes na hora de puni-la.

A matéria determina que não será considerada violação dos direitos autorais o uso de obras, no caso de "reprodução, armazenamento e transformação, em processos de mineração de dados", por instituições de pesquisa, de jornalismo e por museus, arquivos e bibliotecas, desde que:

- não tenha como objetivo a simples reprodução, exibição ou disseminação da obra original em si;

- o uso ocorra na medida necessária para o objetivo a ser alcançado;

- não prejudique de forma injustificada os interesses econômicos dos titulares;

- não concorra com a exploração normal das obras.

Direitos do consumidor

O projeto resguarda os seguintes direitos aos consumidores:

- o direito de ser informado previamente de interações com sistemas de inteligência artificial;

- de ter explicações sobre decisão, recomendação ou previsão tomada por inteligência artificial;

- o usuário também vai poder contestar decisões das plataformas que produzam efeitos jurídicos ou que impactem sua rotina;

- direito à não-discriminação e a correção de vieses discriminatórios.

O texto é resultado do trabalho de uma comissão de juristas, do direito civil e digital, presidida pelo ministro do Superior Tribunal de Justiça (STJ) Ricardo Villas Bôas Cueva. O grupo ouviu a opinião de setenta especialistas da área e consultou a regulamentação da inteligência artificial em mais de 30 países da Organização para a Cooperação e Desenvolvimento Econômico (OCDE).

Simulador humano

O ChatGPT, desenvolvido pela empresa OpenAI, é um exemplo de aplicativo que usa um modelo de inteligência artificial, que cria códigos em várias linguagens de programação. A ferramenta tenta simular o pensamento humano ao gerar uma resposta após receber um estímulo por meio de texto ou imagem.

O robô funciona como uma Alexa/Siri (assistentes de voz do Amazon e da Apple, respectivamente), ou como o buscador do Google, mas que já dá a resposta sem o usuário ter que clicar em links para ler.

O robô recebe um treinamento, é alimentado por códigos e artigos. Depois de receber uma quantidade significativa de dados, ele calcula quais respostas terão mais chances de imitar o pensamento humano. Dessa forma, por ciclo de repetição, o robô oferece soluções como criar sites e jogos do zero, calcular impostos.